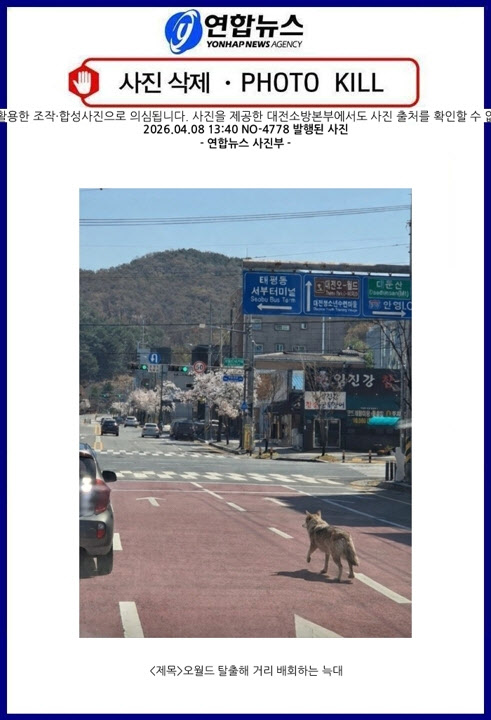

지난 8일 대전 오월드를 탈출한 늑대 ‘늑구’의 행방은 수색 엿새째인 13일까지도 여전히 오리무중이다. 대규모 인력과 드론을 투입하면 전방위 수색을 하고 있지만 사건 초기 수색 방향 설정 단계에서 정교하게 조작된 AI 조작 이미지에 가로막혀 혼선을 빚었다.

[eda20260413100950.170x.0]

사건 당일 소방 당국은 시민 제보 사진이라며 ‘오월드 네거리’를 활보하는 모습이 담긴 이미지를 근거로 수색 범위를 설정했다. 그러나 해당 사진은 도로 표지판과 정지선 등 실제 지형과 다른 요소가 확인된 AI 생성 이미지로 드러났다. 누군가의 무책임한 장난으로 인해 공권력이 엉뚱한 지역을 수색하는 사이 골든타임으로 불리는 초기 48시간은 허무하게 흘러갔다.

문제는 이러한 혼선이 동물 수색에만 국한되지 않는다는 점이다. 만약 화재·지진·테러 등 대형 재난 현장에서 유사한 정보 교란이 발생한다면 그 피해는 훨씬 더 치명적일 수 있다. 잘못된 이미지 한 장으로 구조대가 엉뚱한 곳에 투입되는 사이 실제 현장의 인명 피해는 걷잡을 수 없이 커질 가능성도 배제할 수 없다.

정부와 관계 당국의 대응 과정도 짚어볼 필요가 있다. 대전소방본부는 이미지의 진위 여부를 충분히 검증하지 않은 채 이를 수색 단서로 활용했고 언론에도 배포했다. 대전시는 해당 정보를 근거로 재난 문자를 발송하고 결국 인근 초등학교 휴교까지 결정했다.

기술의 발전은 구조 현장에 효율성을 높이기도 하지만 이번 사례처럼 혼란을 증폭시키는 도구가 될 수도 있다. 이제 정부와 관련 기관은 AI 시대에 맞는 재난 대응 체계를 전면적으로 재검토해야 한다.

제보 내용에 대한 다각적 검증 매뉴얼을 마련할 뿐만 아니라 현장에서 즉시 활용할 수 있는 AI 판별 기술 도입 등 실질적 대책이 필요하다. 나아가 악의적으로 조작된 정보를 유포해 공공 안전을 위협하는 행위에 대해서는 법적 처벌을 강화할 필요가 있다.

이번 늑구 사태가 남긴 교훈을 가볍게 흘려넘긴다면 다음에 마주할 가짜 정보는 훨씬 더 치명적인 결과를 초래할지도 모른다.

(사진= 연합뉴스)