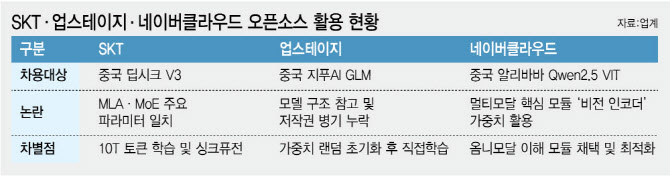

업스테이지와 네이버클라우드 사례에 이어, 국내 국가대표급 AI 모델들이 글로벌 오픈소스를 어디까지, 얼마나 투명하게 활용했는지와 ‘기술 자립’의 기준을 둘러싼 논쟁이 다시 커지는 분위기다.

[이데일리 김정훈 기자]

배경훈 부총리 겸 과학기술정보통신부 장관과 임문영 국가인공지능전략위원회 부위원장, 하정우 AI미래기획수석비서관 등 참석자들이 30일 오후 서울 강남구 코엑스에서 열린 ‘독자 AI 파운데이션 모델’ 프로젝트 1차 발표회에서 기념촬영을 하고 있다.(사진=이영훈 기자)

8일 이데일리가 허깅페이스에 공개된 A.X-K1 기술 리포트 등을 살펴본 결과, A.X-K1은 딥시크의 핵심 아키텍처로 알려진 MLA(Multi-head Latent Attention)와 MoE(Mixture of Experts)에서 세부 설정값(파라미터)이 딥시크 V3 모델과 상당 부분 유사한 것으로 분석됐다.

특히 추론 효율을 높이기 위해 딥시크가 제시한 MLA 구조의 주요 수치들이 A.X-K1에서도 확인됐고, 필요한 전문가 모듈만 선택적으로 활용하는 MoE 전략에서도 전문가 반영 강도, 호출 방식(Sigmoid) 등 설계 요소가 비슷하다는 평가다.

학습 인프라 운용 방식에서도 유사 지점이 거론됐다. 500B(5000억)급 거대 모델 학습 과정에서 병목을 줄이기 위해 딥시크가 개발한 전문가 병렬화(EP) 통신 라이브러리 ‘DeepEP’ 방식이 활용된 정황이 확인됐다는 것이다.

이에 대해 SKT 측은 글로벌 트렌드를 수용한 부분이 있다는 점은 인정하면서도, 단순한 모방으로 보기는 어렵다는 입장이다.

SKT 고위 관계자는 “효율적인 아키텍처를 채택하는 것은 자동차 엔진 구조가 표준화되는 것과 비슷한 측면이 있다”며 “중요한 것은 파라미터 초기화 이후 우리만의 컴퓨팅 자원과 학습 데이터로 구현해 글로벌 수준의 성능을 만들어내는 엔지니어링 역량”이라고 강조했다. 또 “오픈소스를 기반으로 빠르게 추격하고 그 성과를 다시 공유하는 것은 글로벌 AI 커뮤니티의 선순환 철학”이라고 설명했다.

네이버·업스테이지도 겪은 ‘차용’ 공방

이 같은 ‘차용’ 논란은 업계 전반으로 확산하는 양상이다. 네이버클라우드는 멀티모달 모델의 핵심인 ‘비전 인코더’를 알리바바의 ‘Qwen2.5 ViT’에서 가져왔다는 지적을 받았고, 업스테이지도 초기 모델이 미스트랄AI 구조에 기반한 걸 숨겼다는 논란과 함께, 지푸AI 모델(GLM)구조를 참고하는 과정에서 저작권 표기 논란이 불거진 바 있다.

성낙호 네이버클라우드 하이퍼스케일 AI 기술총괄은 “기술 선택과 라이선스 정보를 허깅페이스와 테크리포트로 공개해왔다”고 말했다. 김성훈 업스테이지 대표는 지난 2일 공개 검증회에서 “가중치(Weight)를 랜덤하게 초기화한 상태에서 학습을 시작했다면 프롬 스크래치 모델”이라고 해명했다.

SKT A.X K1 주요 특징(사진=SKT)

업계에서는 한 업체만 문제 삼기 어려운 구조라는 목소리도 나온다. 최근 글로벌 AI 성능 평가 기관 ‘아티피셜 애널리시스(AA)’에서 국내 모델 중 1위를 기록한 모티프테크놀로지스의 임정환 대표는 “이번 경쟁에서 고유 아키텍처를 고수하며 바닥부터 설계하는 곳은 LG AI연구원 정도”라며 “정부 과제의 짧은 데드라인과 제한된 자원 속에서 검증된 글로벌 오픈소스를 적극 활용할 수밖에 없는 환경”이라고 평가했다. 그는 “특정 모듈 차용이 문제라면, 오픈소스 기반으로 개발한 국내 기업 다수도 그 비판에서 자유롭기 어렵다”고 덧붙였다.

반면, AI 업계에서는 이것을 ‘프롬 스크래치’ 훼손 요소로 보지 않는다는 시각도 있다. 포티투마루 이승현 부사장은 페이스북을 통해 “SKT가 A.X K1 관련 무려 5,190억 파라미터라는 가장 큰 규모를 자랑했는데, 100% 가중치를 from scartch 로 학습했다. 타사 모델(Llama 등)의 가중치를 일절 사용하지 않고 10조 토큰 자체 학습 수행했고, 독자 토크나이저도 구축했다”고 밝히기도 했다.

정부, ‘소버린AI’ 독자성 정밀 점검…판별 기준은 통제권·수정역량

정부는 이번 논란을 ‘소버린 AI’의 본질과 직결된 사안으로 보고 있다. 과기정통부는 독자 AI 파운데이션 모델 프로젝트 참여 컨소시엄들을 대상으로 기술적 독자성 기준을 정밀 점검할 계획이다. 과기정통부 고위 관계자는 “소버린 AI의 핵심은 오픈소스 활용의 적법성을 넘어 ‘자주권’과 ‘통제권’에 있다”며 “글로벌 모델을 참고했더라도, 문제가 생겼을 때 우리 기술진이 독자적으로 구조를 수정·개선할 수 있는 역량이 있는지가 핵심 판별 기준이 될 것”이라고 밝혔다.

정부가 지난해 8월 네이버클라우드, 업스테이지, SK텔레콤, NC AI, LG AI연구원을 ‘K-AI’ 국가대표로 선정한 취지가 ‘기술 자주권 확보’에 있는 만큼, 이르면 16일 발표될 평가 결과에도 관심이 쏠린다. 정부는 5개 기업 중 기술적 완성도와 독자성이 상대적으로 미흡한 1개 팀을 탈락시킬 예정이다.