AI 기본법에서 실제 위험성이 높은 AI를 규제하기 위한 ‘고영향 AI’의 경우 에너지, 대출심사, 먹는물, 교통, 채용, 교육 등 사람의 기본권에 중대한 영향 또는 위험한 업무에 적용되는 것으로 규정됐다. 다만 현존하는 기술 중 ‘고영향 AI’로 분류될 수 있는 분야는 운전자 개입 없이 스스로 작동하는 완전 자율주행 기술(레벨4)만 해당한다. 안전성의 경우 학습에 사용된 누적연산량 10의 26승 이상 최첨단 AI기술이 적용된 ‘고위험 AI’ 모델이 대상인데 국내에는 이같은 모델이 아직 없다.

이상용 건국대학교 법학전문대학원 교수는 “수천명의 인명 손실이나 수백조 재산 피해를 전제로 그 정도 중대 사항이면 맥락과 무관하게 통제할 필요 있겠지만 안전성은 사전 예방 조항으로 그에 해당하는 AI가 없다는 것”이라며 “위험을 다르게 정의할 수 있는 기준점이 필요한데 10의 26승이라는 연산량 제공으로 분류한 것”이라고 설명했다.

과기정통부는 기업의 혼란을 최소화하고, 현장에서 충분히 준비할 시간을 제공하기 위해 최소 1년 이상 규제를 유예한다. 해당 기간 동안 사실조사, 과태료 관련 계도기간을 운영하며 사실조사는 인명사고, 인권훼손 등 중대한 사회적 문제 발생하는 등 극히 예외적인 경우에만 실시할 예정이다.

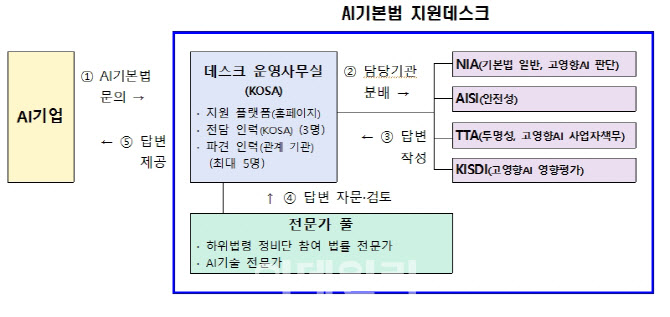

기업의 법 이행 준비 지원을 위해 하위법령 제정에 참여한 전문가로 구성된 ‘인공지능기본법 지원데스크’도 개설·운영한다. 지원데스크에서는 법과 관련된 기업의 문의와 애로사항을 해소하기 위해 전문가들이 검토·분석을 통해 기업에게 상세한 컨설팅을 제공할 예정이다. 영업비밀 유출 등을 우려하는 기업을 고려해 상담 내용은 비밀로 관리하고, 익명 컨설팅도 제공한다.

과기정통부 관계자는 “AI 생성물에 대한 워터마크 적용은 딥페이크 오용 등 기술의 부작용을 막기 위한 최소한의 안전장치이자, 이미 주요 글로벌 기업들이 도입하고 있는 세계적인 추세”라며, “이번 인공지능기본법 시행을 통해 현장에서의 법적 불확실성이 제거되고 건강하고 안전한 국내 AI생태계가 조성되기를 기대한다”고 밝혔다.